Luận án Nghiên cứu một số bài toán trong hỏi đáp cộng đồng

Trang 1

Trang 2

Trang 3

Trang 4

Trang 5

Trang 6

Trang 7

Trang 8

Trang 9

Trang 10

Tải về để xem bản đầy đủ

Bạn đang xem 10 trang mẫu của tài liệu "Luận án Nghiên cứu một số bài toán trong hỏi đáp cộng đồng", để tải tài liệu gốc về máy hãy click vào nút Download ở trên.

Tóm tắt nội dung tài liệu: Luận án Nghiên cứu một số bài toán trong hỏi đáp cộng đồng

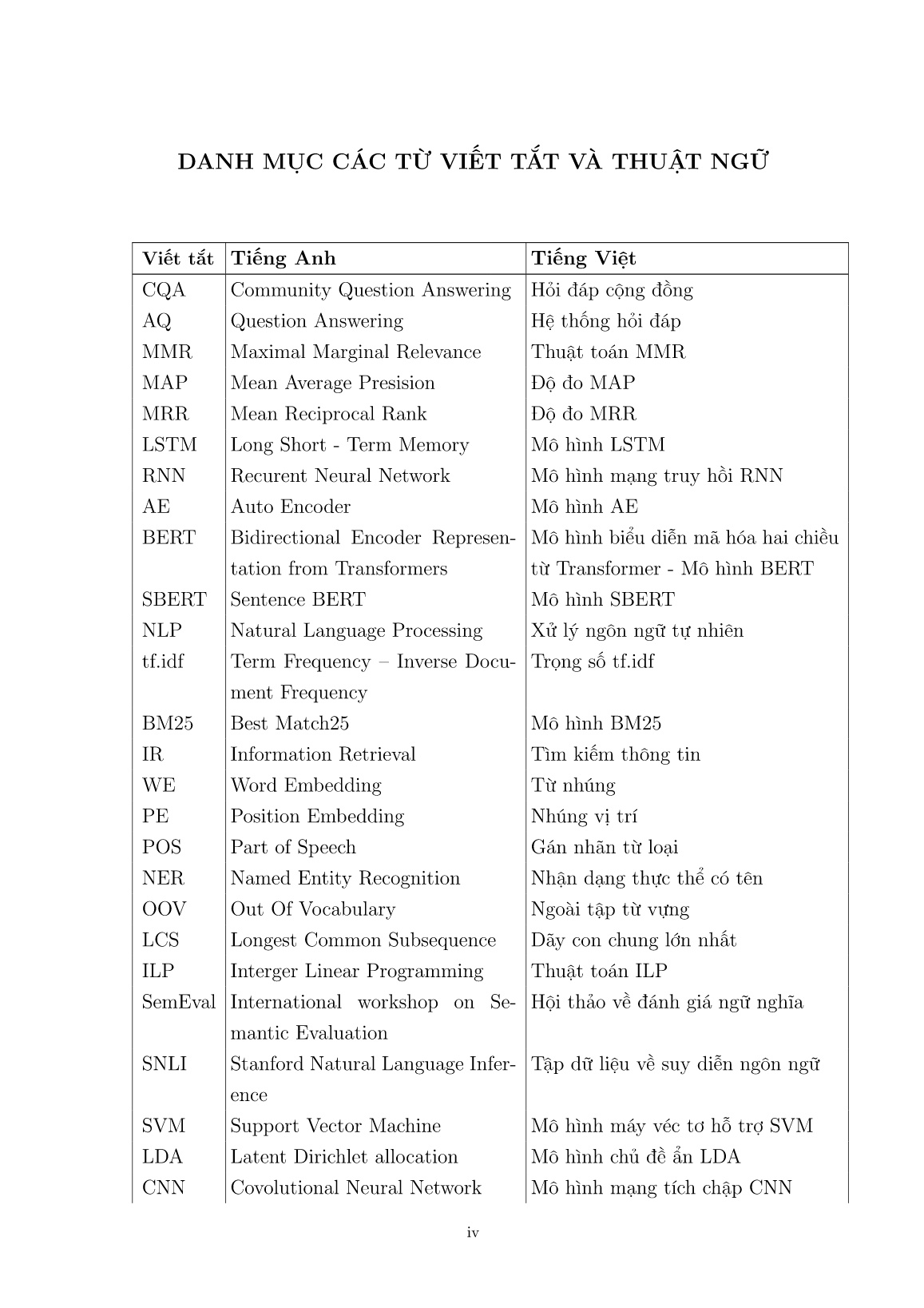

ự cosin được sử dụng. Véc tơ biểu diễn từ được học từ mô hình fastText [35] trên tập dữ liệu hỏi đáp cộng đồng SemEval 2016 và SemEval 2017 ngôn ngữ tiếng Anh không gán nhãn. fastText là mô hình học biểu diễn từ qua việc tổng hợp từ các véc tơ n-gram kí tự, trong đó mỗi từ được biểu diễn qua túi n-gram kí tự (ví dụ từ ’where’ biểu diễn qua 48 Bảng 2.1: Bảng thống kê số cặp câu hỏi-câu trả lời trong tập dữ liệu SemEval CQA. SemEval 2016 SemEval 2017 Train 36.198 39.468 Dev 2.440 3.270 Test 3.270 2.930 Độ dài trung bình của phần nội dung câu hỏi 49.4 45.8 Độ dài trung bình của câu trả lời 38.8 38.0 Kích thước từ điển 61.271 63.758 3-gram là ’’). Phương pháp biểu diễn này là biểu diễn hiệu quả với tập dữ liệu có nhiều từ không có trong tập từ vựng. Sau đó, trọng số tf.idf được thêm vào công thức tính gkj để nhấn mạnh các từ chứa nội dung trong câu. Công thức cụ thể như sau: g ′ kj = tf.idf(w q j)cosine(w t k,w q j), (2.9) trong đó wtk và w q j là các véc tơ từ học từ mô hình fastText. Để tính trọng số tf.idf , mỗi văn bản là câu hỏi hoặc câu trả lời trên tập dữ liệu không gán nhãn. Từ đặc biệt được thêm vào cuối câu hỏi và câu trả lời với mục đích để các từ không chứa nội dung quan trọng trong câu sẽ ánh xạ vào từ đặc biệt này. Cuối cùng trọng số gkj được chuẩn hóa sử dụng hàm softmax: gkj = exp(gkj)∑M i=1 exp(g ′ ki) , (2.10) trong đó k = 1..N , j = 1..M , M là số từ của câu hỏi, N là số từ trong câu trả lời. 2.4. Các thử nghiệm và kết quả 2.4.1. Tập dữ liệu Tập dữ liệu SemEval có nhãn [21, 20] được sử dụng để đánh giá mô hình. Dữ liệu trên tập này được lấy từ forum Qatar Living về các chủ đề dành cho những người nước ngoài đã và sẽ tới Qatar. Tập dữ liệu này được chia thành 3 tập: tập huấn luyện, tập phát triển và tập kiểm thử. Bảng 2.1 là dữ liệu thống kê trên tập dữ liệu này. Ngoài ra tập dữ liệu không có nhãn được cung cấp bởi cuộc thi Sememval 2017 1 bao gồm 189.941 câu hỏi và 1.894.456 câu trả lời với kích thước từ điển là 1https://alt.qcri.org/semeval2017/task3/index.php?id=data-and-tools 49 63.758 từ được dùng để huấn luyện các từ nhúng Word2vec, Glove và fastText sử dụng thử nghiệm trong mô hình. Độ đo MAP(Mean Average Precision) và MRR (Mean Reciprocal Rank) được sử dụng để đánh giá hiệu năng của mô hình với kịch bản được cung cấp bởi cuộc thi SemEval2. MRR được tính theo công thức sau: MRR = 1 |Q| |Q|∑ i=1 1 ranki , (2.11) trong đó ranki là vị trí của câu trả lời đúng đầu tiên tương ứng với câu hỏi thứ i. Trong khi độ đo MRR đo thứ hạng của câu trả lời đúng đầu tiên thì MAP lại xem xét tất cả thứ hạng của câu trả lời đúng. MAP được tính như sau: MAP = 1 |Q| |Q|∑ j=1 1 mj |mj |∑ k=1 Precision(Rjk), (2.12) trong đó Rjk là tập kết quả tìm kiếm được xếp hạng từ kết quả tốt nhất cho đến khi tìm thấy câu trả lời thứ k, mj là số câu trả lời đúng cho câu hỏi thứ j trong số Q câu hỏi. 2.4.2. Chọn các tham số trong các mô hình Mô hình Glove [31] được sử dụng với số chiều là 300 cho lớp đầu vào cho tất cả các mô hình. Những từ không có trong từ điển được khởi tạo một cách ngẫu nhiên. Số chiều của biểu diễn từ ở mức độ kí tự được chọn là 50 trong các mô hình match-LSTM và mô hình mở rộng được học qua mô hình biLSTM. Số chiều của véc tơ ẩn của các đường LSTM trong tất cả các mô hình được thiết lập là 300. Số chiều véc tơ ẩn của đường mLSTM trong mô hình match-LSTM và mô hình mở rộng là 600. Véc tơ từ được học qua mô hình fastText [35] để tính toán độ tương tự trong phần cơ chế chú ý có giám sát là 100. Các tham số của các mô hình được cài đặt để so sánh với mô hình đề xuất được thống kê trong bảng 2.2. Thuật toán tối ưu Adam được sử dụng với tốc độ học η = 0, 0001 và hai tham số β1 = 0, 9 và β2 = 0, 999. Hệ số điều chỉnh λ và γ được thiết lập là 0,0001, kích thước lô - batch size là 64. Để tránh hiện tượng quá khớp, các kỹ thuật drop-out được sử dụng với tỉ lệ là 30% của tất cả các lớp ẩn và dừng sớm trên tập phát triển tại epoch thứ 32. 2https://alt.qcri.org/semeval2017/task3/ 50 Bảng 2.2: Các tham số của các mô hình thực nghiệm Mô hình Thiết lập các tham số QA-LSTM Kích thước véc tơ ẩn LSTM : 300 QA-LSTM-CNN Kích thước véc tơ ẩn LSTM : 300, Sử dụng kết hợp các kích thước nhân của kernel CNN là 2 *300, 3*300, 4*300, 5*300. QA-LSTM-attention Kích thước véc tơ ẩn LSTM : 300 Enhanced LSTM Kích thước vector ẩn LSTM : 300 Match LSTM Kích thước véc tơ ẩn LSTM : 300, Kích thước vector ẩn mLSTM: 600 Enhenced match LSTM Kích thước véc tơ ẩn LSTM : 300, Kích thước véc tơ ẩn mLSTM : 600, Kích thước của véc tơ từ mức kí tự biLSTM:50 Enhanced match-LSTM +Sup.att Kích thước véc tơ ẩn LSTM : 300, Kích thước véc tơ ẩn mLSTM : 600, Kích thước của véc tơ từ học ở mức kí tự biLSTM: 50, Số chiều của mô hình fastText: 100 Bảng 2.3: Kết quả so sánh mô hình đề xuất với các mô hình khác trên tập dữ liệu SemEval 2016 và 2017 Models SemEval 2017 SemEval 2016 MAP MRR MAP MRR (A) QA-LSTM 86,68 91,01 74,36 83,4 (B) QA-LSTM-CNN 87,17 92,59 74,97 83,56 (C) QA-LSTM-attention 87,39 91,50 75,87 82,88 (D) Enhanced LSTM 87,23 93,04 76,46 83,51 (E) match-LSTM 86,51 92,12 77,70 83,76 — (E) + Max-pooling 86,90 92,13 78,00 83,90 — (E) + Max-pooling + CharRNN 87,10 92,26 78,01 84,11 (F) Enhanced match-LSTM 87,87 92,28 78,10 84,21 (G) Enhanced match-LSTM + sup. att. 88,38 93,13 78,62 84,56 (H) QCN 88,51 - - - (I) KELP 88,43 92,82 79,19 86,42 (J) ECNU 86,72 91,45 77,28 84,09 Các mô hình được thử nghiệm trên Tensorflow và cài đặt bằng ngôn ngữ Python 3.6 và tất cả thử nghiệm này được thực hiện trên GPU Nvidia Tesla p100 16Gb. Tập phát triển được sử dụng để lựa chọn siêu tham số tốt nhất để thiết lập trên tập kiểm thử. 2.4.3. Kết quả và các thảo luận Phần này diễn tả chi tiết các kết quả thử nghiệm trên tập dữ liệu SemEval (bảng 2.3). Bảng kết quả bao gồm ba phần: từ dòng (A-D) mô tả kết quả thực hiện trên một số mô hình LSTM và CNN đã được đề xuất cho bài toán lựa chọn câu trả lời, từ dòng (E) đến dòng (F) là kết quả mô tả quá trình phát triển từ mô hình match-LSTM đến mô hình đề xuất. Dòng (H-J) là kết quả mới nhất công bố trên tập SemEval tính tới thời điểm mô hình mà mô hình match-LSTM 51 tích hợp cơ chế chú ý có giám sát được đề xuất. Mô hình đề xuất được so sánh so sánh với các mô hình sau: • Mô hình QCN [40]: xem xét phần chủ đề (subject) của câu hỏi như là phần chính của câu hỏi đồng thời tổng hợp với phần nội dung (body) của câu hỏi kết hợp với cơ chế chú ý để khai thác sự tương tác giữa câu hỏi và câu trả lời. Cuối cùng mô hình đi qua lớp mạng CNN để biểu diễn câu hỏi và câu trả lời. • Mô hình KELP[83]: Mô hình này sử dụng nhân cú pháp (Syntactic Kernel) kết hợp với độ tương tự ngữ nghĩa, độ tương đồng từ vựng, độ tương đồng về ngữ pháp và một số đặc trưng đặc biệt khác đưa vào mô hình SVM để dự đoán. Đây là mô hình có kết quả đứng đầu trong cuộc thi SemEval 2017 với bài toán lựa chọn câu trả lời. • Mô hình ECNU[84]: Mô hình này kết hợp hai mô hình bao gồm mô hình có giám sát với các đặc trưng cơ bản và mô hình CNN để biểu diễn câu hỏi và câu trả lời. • Các mô hình QA-LSTM, QA-LSTM-CNN, QA-LSTM attention [7]: Các mô hình này thực hiện so khớp câu trả lời với câu hỏi liên quan về mặt ngữ nghĩa phức tạp trong câu. Trong đó mô hình QA-LSTM-CNN là mô hình lai giữa LSTM và CNN dùng cho bài toán QA. Sau đó cơ chế chú ý được kết hợp sử dụng vào mô hình QA-LSTM để học biểu diễn câu trả lời tốt hơn khi đưa câu hỏi đầu vào. Mỗi đầu ra của mô hình LSTM trên câu trả lời tại bước thứ t được cập nhật qua các tham số của biểu diễn của câu hỏi và các trọng số chú ý. • Mô hình Enhance-LSTM [85]: Mô hình này lúc đầu được đề xuất cho bài toán suy diễn ngôn ngữ bằng cách xem xét các kiến trúc đệ quy kết hợp với mô hình suy diễn cục bộ và suy diễn kết hợp. Các mô hình trong bảng 2.3 từ dòng (A) đến dòng (G) được cài đặt và thực thi trực tiếp trên Tensorflow. Kết quả của các mô hình trong các dòng (H-J) được thống kê lại trong bài báo gốc trên tập dữ liệu SemEval. Bảng 2.3 cho thấy mô hình match-LSTM gốc lúc đầu cho hiệu năng tương đương với các mô hình LSTM và CNN khác ở dòng (A-D). Khi thêm một số mở rộng vào mô hình này như trình bày ở phần 2.3.2, độ đo MAP và MRR của mô hình này đều tăng một cách ổn định trên cả hai tập SemEval 2016 và SemEval 52 Bảng 2.4: Bảng kết quả so sánh mô hình math-LSTM và các mô hình mở rộng từ mô hình này khi thực hiện nối subject+body của câu hỏi Models SemEval CQA 2017 SemEval CQA 2016 MAP MRR MAP MRR match-LSTM (body) 86,51 92,12 77,70 83,76 math-LSTM (subject+body) 86,59 91,68 77,71 83,45 Enhanced match-LSTM (body) 87,87 92,28 78,10 84,21 Enhance match-LSTM (subject+body) 87,81 91,21 78,00 84,20 Enhanced match-LSTM + sup. att.(body) 88,38 93,13 78,62 84,56 Enhanced match-LSTM + sup. att.(sub.+body) 87,89 92,20 78,55 84,45 2017. Đặc biệt mô hình Enhanced match-LSTM tại dòng (F) cao hơn các mô hình LSTM ở dòng (A) tới (D) ở cả hai tập SemEval CQA 2016 và SemEval CQA 2017. Khi thêm cơ chế chú ý có giám sát (trình bày tại phần 2.3.3) hiệu năng của mô hình tăng đáng kể trên cả hai tập dữ liệu này. Mô hình đề xuất đạt MRR cao nhất trên tập SemEval CQA 2017 là 93, 13% ở dòng (G) so với tất cả các mô hình còn lại. Còn MAP và MRR trên tập SemEval CQA 2016 thấp hơn so với mô hình đứng đầu KELP. Điều này chứng tỏ rằng cơ chế chú ý có giám sát có khả năng học được ngữ nghĩa câu hỏi và câu trả lời tốt hơn so với các mô hình LSTM trước đó. Đặc biệt là cơ chế chú ý có giám sát không những học được nhiều ngữ nghĩa hơn trong việc gióng từ (thảo luận phần 2.4.4 bên dưới) mà còn giúp cho mô hình dự đoán câu trả lời tốt hơn. Cụ thể là mô hình tích hợp đã vượt qua đội KELP với độ đo MRR trên tập SemEval CQA 2017, còn lại độ đo MAP ngang bằng với các kết quả đứng đầu trong hai tập dữ liệu này. Để thăm dò sự ảnh hưởng của phần chủ đề (subject) trong câu hỏi, phần chủ đề được nối với thân của câu hỏi (subject+body) tạo thành nội dung của câu hỏi. Kết quả tại bảng 2.4 cho thấy rằng chủ đề của câu hỏi không ảnh hưởng đến kết quả của mô hình đề xuất mà thậm chí kết quả còn thấp hơn trên cả hai mô hình Enhanced match-LSTM và mô hình tích hợp cơ chế chú ý có giám sát [40]. Điều đó chứng tỏ rằng mô hình có khả năng tổng hợp ngữ nghĩa của câu hỏi và câu trả lời tốt hơn các mô hình LSTM trước đó mà không cần phải tích hợp thêm chủ đề của câu hỏi. Cuối cùng, các phương pháp biểu diễn từ bằng mô hình fastText, Word2vec và Glove được sử dụng để tính trọng số chú ý gkj để hướng dẫn mô hình học. Độ tương tự cosin được sử dụng để tính gkj từ hai véc tơ biểu diễn từ. Véc tơ từ được học từ các mô hình khác nhau như fastText, Glove và Word2vec được thử nghiệm. Các mô hình này được huấn luyện trên tập dữ liệu cộng đồng không 53 gán nhãn SemEval 2017 CQA. Bảng 2.5 chỉ ra kết quả khi thực hiện trên các biểu diễn này. Kết quả cho thấy rằng, với cách biểu diễn sử dụng fastText cho kết quả tốt nhất, cao hơn hẳn với mô hình Word2Vec và Glove. Nguyên nhân của việc dùng Word2vec và Glove cho kết quả thấp là do bộ từ điển của tập dữ liệu SemEval không nhãn lớn chứa nhiều từ hiếm trong khi fastText hoạt động tốt trên tập dữ liệu CQA do biểu diễn từ được tổng hợp từ các n-gram từ mô hình Word2vec [35]. fastText phù hợp với tập dữ liệu có bộ từ điển lớn (dữ liệu trình bày tại mục 2.4.1), học được ngữ nghĩa tốt hơn do đưa vào hình thái của từ qua n-gram. Bảng 2.5: Bảng so sánh độ đo MAP với trọng số chú ý gkj được tính từ các biểu diễn từ khác nhau để hướng dẫn mô hình Enhanced match-LSTM + supervised attention học trọng số chú ý trên tập SemEval 2017. Mô hình MAP fastText 88,38 Word2vec 85,51 Glove 85,00 2.4.4. Trực quan hóa các trọng số chú ý (a) Cơ chế chú ý có giám sát với độ tương tự từ (b) Cơ chế chú ý có giám sát với độ tương tự từ và tfidf Hình 2.5: Một ví dụ minh họa trọng số chú ý được học bởi mô hình match-LSTM kết hợp với cơ chế chú ý có giám sát với cặp câu hỏi và câu trả lời tốt của nó. Hình 2.5 và hình 2.6 được sử dụng để trực quan hóa trọng số chú ý giữa từ với từ của câu trả lời (tương ứng với trục tung) và câu hỏi (tương ứng với trục hoành). Qua việc trực quan hóa trọng số chú ý cũng giải thích về tính hiệu quả của mô hình đề xuất. Mỗi hình vuông nhỏ là mô tả trọng số chú ý αkj giữa một từ của câu trả lời với một từ trong câu hỏi. Hình vuông có màu đậm hơn mô tả trọng số chú ý αkj lớn hơn. Nhìn chung, mô hình match-LSTM kết hợp cơ chế 54 (a) Cơ chế chú ý có giám sát với độ tương tự từ (b) Cơ chế chú ý có giám sát với độ tương tự từ và tfidf Hình 2.6: Một ví dụ về trọng số chú ý được học bởi mô hình match-LSTM kết hợp với cơ chế chú ý có giám sát với cặp câu hỏi và câu trả lời không tốt của nó. chú ý có giám sát học ra trọng số chú ý của từ trong câu trả lời với các từ trong câu hỏi tốt hơn so với mô hình match-LSTM gốc ban đầu (so với hình 2.2 của mô hình gốc). Xem xét chi tiết hơn, ở hình 2.5 các từ chứa nội dung của trả lời như ‘Pak- istanis’, ‘ban’, và ‘get’ và các từ chứa nội dung của câu hỏi như ‘nationalities’, ‘banned’, và ‘apply’ được ánh xạ rất chính xác. Từ ’ban’ và ’banned’ về bản chất có cùng từ gốc giống nhau. Mô hình đề xuất cũng dự đoán được các từ tương đồng ngữ nghĩa như ‘Pakistanis’ và ‘nationalities’, từ ’get’ và ’apply’. Cuối cùng khi quan sát kĩ hơn trong hình 2.5(a), các từ dừng và dấu ngắt câu vẫn được ánh xạ tới các từ khác. Trong khi đó ở hình 2.5(b) nhờ vào trọng số tf.idf trong công thức 2.9 mà các từ dừng và dấu ngắt câu học được ánh xạ vào các từ đặc biệt được thêm vào cuối câu hỏi. Điều này thể hiện qua cột ô vuông ở cuối của hình 2.5(b) chứa nhiều các ô vuông màu xanh đậm. Hơn nữa, trong hình vẽ này cho thấy rằng các từ dừng và dấu ngắt câu trong câu hỏi không chú ý tới các từ trong câu trả lời nữa. Do đó, đoạn văn bản dư thừa không mang nội dung như lời chào hỏi hay những đoạn không mang ý nghĩa đều có trọng số chú ý thấp với các từ trong câu còn lại. Tương tự với hình 2.6 đối với cặp câu hỏi và câu trả lời có nhãn là 0. Từ mang nội dung như ’your nationality’ được ánh xạ tới từ ’nationalities’ ở hình 2.6(b). Cũng do câu hỏi và câu trả lời về cơ bản không liên quan về ngữ nghĩa tới nhau cho nên phần ánh xạ giữa các từ trong hai câu này không rõ ràng. Tất cả những lý giải trên chứng tỏ rằng mô hình đề xuất học được những phần quan trọng mang nội dung của câu trả lời và ánh xạ với nội dung liên quan của câu hỏi tốt hơn so với mô hình gốc. 2.5. Kết luận chương 2 Tóm lại, chương 2 của luận án thực hiện các công việc như sau: 55 • Các mô hình LSTM cơ bản như QA-LSTM, QA-LSTM-CNN, QA-LSTM- attention và Enhance-LSTM được cài đặt thử nghiệm lại trên bài toán lựa chọn câu trả lời. • Mô hình match-LSTM được đề xuất sử dụng trên bài toán lựa chọn câu trả lời. Sau đó, mô hình này được mở rộng để phù hợp hơn với dữ liệu mạng xã hội. Cụ thể như kết hợp biểu diễn từ ở mức kí tự. Mô hình biLSTM được kết hợp với biểu diễn từ sử dụng mô hình Glove làm đầu vào của mô hình. Cách kết hợp này giúp khắc phục tình trạng OOV trong dữ liệu mạng xã hội. • Đặc biệt, cơ chế chú ý có giám sát được tích hợp vào mô hình mở rộng để hướng dẫn mô hình học theo chú ý xác định trước. Thực nghiệm cho thấy mô hình học ra trọng số chú ý tốt hơn với mô hình gốc. • Để giải thích hiệu quả của mô hình đề xuất, các trọng số chú ý của từng từ trong câu trả lời với các từ trong câu hỏi được trực quan hóa đối với cặp câu hỏi và câu trả lời tốt, câu hỏi với câu trả lời không tốt. Các kết quả được trình bày trong chương 2 được công bố trong bài báo "Supervised Attention for Answer Selection in Community Question Answering" tại tạp chí IAES International Journal of Artificial Intelligence (IJ-AI)3 của Indonesia trong danh mục Scopus. 3 56 Chương 3 BÀI TOÁN TÓM TẮT CÂU TRẢ LỜI TRONG HỆ THỐNG HỎI ĐÁP CỘNG ĐỒNG Trong hệ thống hỏi đáp cộng đồng, ngoài những câu hỏi factoid (câu hỏi về ai, ở đâu, cái gì, khi nào) người dùng còn đặt nhiều câu hỏi non-factoid. Câu hỏi non-factoid thường là các câu hỏi mở như câu hỏi dạng liệt kê, mô tả, quan điểm. Câu trả lời của những dạng câu hỏi này phần lớn phức tạp, cả đoạn văn và không đầy đủ. Tiếp theo chủ đề đảm bảo chất lượng câu trả lời, để giúp người hỏi tổng hợp câu trả lời tốt nhất từ các câu trả lời của người dùng khác, một giải pháp đặt ra là tiến hành tóm tắt các câu trả lời đã có. Chương này trình bày một phương pháp tóm tắt các câu trả lời của câu hỏi non-factoid trong hệ thống CQA. Cụ thể, hai mô hình học biểu diễn câu không giám sát Auto-Encoder và mô hình LSTM-AutoEcoder được đề xuất sử dụng vào quá trình tóm tắt câu trả lời. Các biểu diễn câu được sử dụng để tính độ nổi bật của câu so với câu hỏi, sau đó đưa vào thuật toán MMR (Maximal Marginal Relevance) để tóm tắt câu trả lời theo kiểu trích rút và hướng truy vấn. Kết quả cho thấy rằng phương pháp biểu diễn câu không giám sát cho kết quả tương đương và thậm chí còn cao hơn với phương pháp biểu diễn có giám sát ở một số độ đo. 3.1. Giới thiệu Trong hệ thống hỏi đáp cộng đồng (ví dụ như Yahoo Answers1, StackOver- flow2) có các bài toán chính: (1) Đánh giá chất lượng câu trả lời đã có trong hệ thống, (2) Tìm các câu hỏi tương đồng với câu hỏi truy vấn mới, (3) Tìm kiếm chuyên gia trong hệ thống hỏi đáp. Trong đó, bài toán tóm tắt các câu trả lời thuộc bài toán thứ nhất trong số các bài toán này [8]. Trong hệ thống CQA, một câu hỏi khi được đăng lên có thể có rất nhiều người trả lời (có những câu hỏi lên đến hàng trăm câu trả lời, ví dụ như hệ thống hỏi đáp Yahoo!answer 3). Trong số các câu trả lời đó người dùng phải đọc và lựa chọn những câu trả lời tốt nhất. Theo Liu và cộng sự [8] thống kê có 78% các câu trả lời tốt nhất được dùng lại để trả lời cho các câu hỏi tương đồng được hỏi 1https://answers.yahoo.com/ 2https://stackoverflow.com/ 3https://answers.yahoo.com/question/index?qid=20210324111544AA31SKY 57 Câu hỏi: How do you help your family with dealing with your cancer? I have a 15 year old who has little contact with her father I know that she’s going to be especially afraid of something happening to me. Even though they are pretty sure it’s 1st stage breast cancer and the prognosis is good how do I help her deal with her fear? I also have to deal with what I’m going through are there support groups for the families or children of cancer patients? Câu trả lời 1 : There are support groups for families and children of cancer patients. You should start with your oncologist and ask for a medical social worker. Usually the social workers known all the local support groups or may even be involved with them. That is the first place to start. There are also online groups that can be of assistance. However, you may be surprised by your daughter . .she may be stronger than you imagine. To begin with the best way to deal with her fear is to tell her the truth always. The imagination is far worse . tell her exactly what is happening. If you go to the doctor, tell her why. Tell her if you are having treatment. Explain the treatment. Include your daughter as much as she wants to be included. Obviously if she does not want to be involved or hear this . than back away a bit. But always make sure she hears the truth from you. There is no substitute for honesty. share the good news and the bad. Your daughter will feel included and not left out. She will appreciate your honesty and learn about courage and strength from you..To help guide you through any of this, you can use the following online resources: Cancer Care - free online counseling for cancer patients and families that helps get you started.Best of luck. . Câu trả lời 2 : YOU should give the family some common sense information about the type of cancer that is being experienced. They should be informed as to what they should expect as your reaction to it, and what cures are available. Then you should ask them to pray for you and have their church family also pray for you. I am talking about continuou

File đính kèm:

luan_an_nghien_cuu_mot_so_bai_toan_trong_hoi_dap_cong_dong.pdf

luan_an_nghien_cuu_mot_so_bai_toan_trong_hoi_dap_cong_dong.pdf thong_tin_dua_len_mang_TA.doc

thong_tin_dua_len_mang_TA.doc thong_tin_dua_len_mang_TA.pdf

thong_tin_dua_len_mang_TA.pdf thong_tin_dua_len_mang_TV.doc

thong_tin_dua_len_mang_TV.doc thong_tin_dua_len_mang_TV.pdf

thong_tin_dua_len_mang_TV.pdf tomtat_luanan_KHONGcotenphanbien.pdf

tomtat_luanan_KHONGcotenphanbien.pdf trich_yếu.doc

trich_yếu.doc trich_yếu.pdf

trich_yếu.pdf